大数据分析--人工智能算法

人工神经网络应该是一类无法回避的机器学习算法,现在也是最热门的,有很多不同的网络结构。首先,全连接的神经网络是一种非常传统的模型,其相邻层的神经元两两之间都是连接的。全连接神经网络相较于全连接神经网络,卷积神经网络采用了卷积层,减少了参数的数量。卷积神经网络在卷积神经网络的基础上,何恺明等人提出了残差网络,通过引入跨层连接,降低了训练难度。残差网络最后,残差收缩网络[1][2]又是残差网络的一种改

·

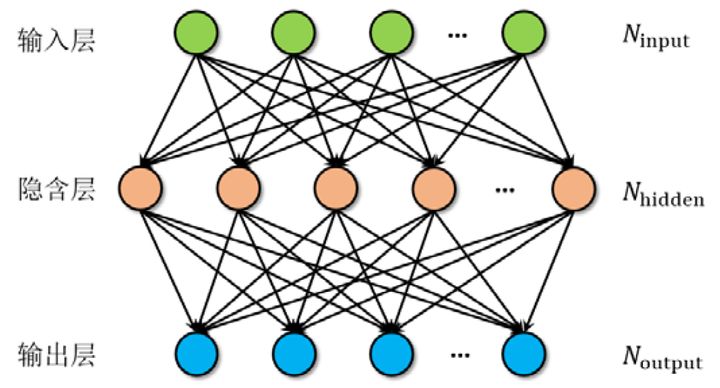

人工神经网络应该是一类无法回避的机器学习算法,现在也是最热门的,有很多不同的网络结构。

首先,全连接的神经网络是一种非常传统的模型,其相邻层的神经元两两之间都是连接的。

全连接神经网络

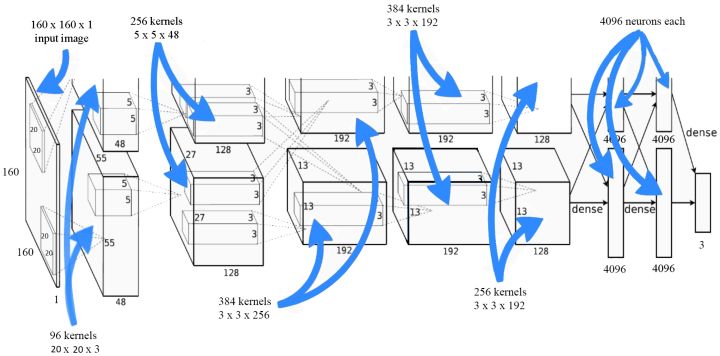

相较于全连接神经网络,卷积神经网络采用了卷积层,减少了参数的数量。

卷积神经网络

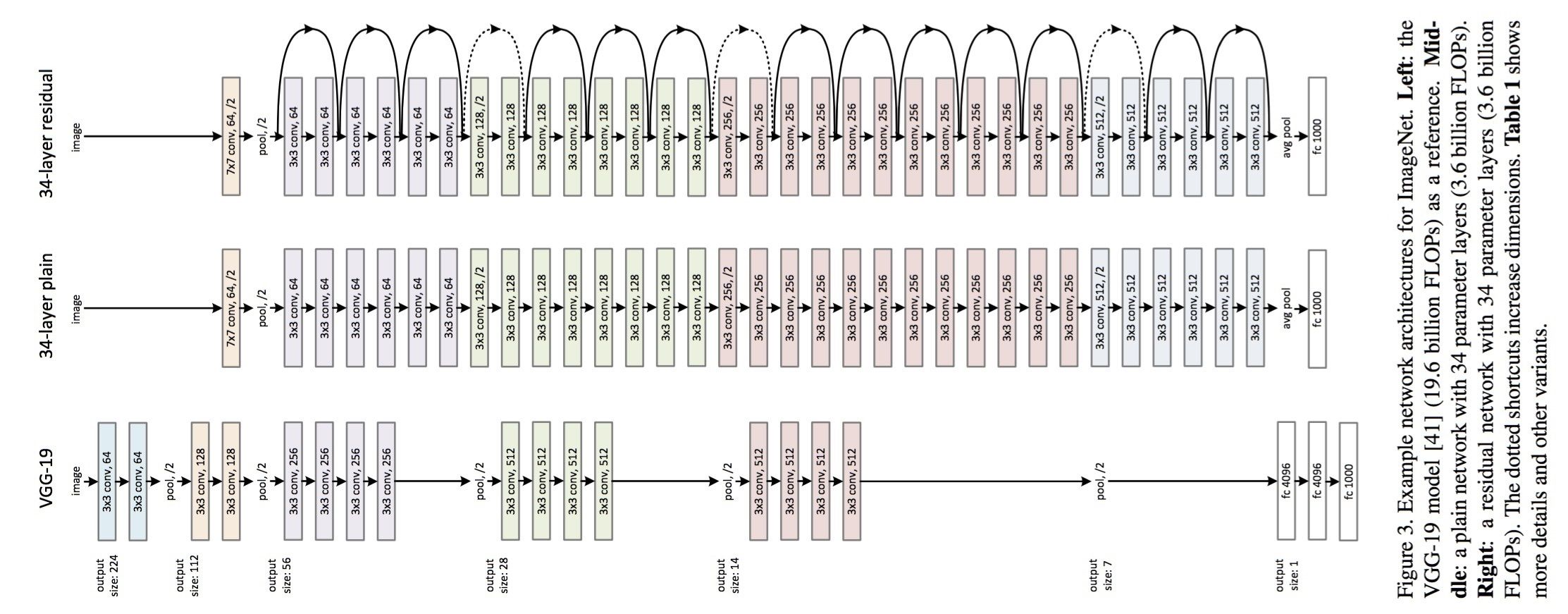

在卷积神经网络的基础上,何恺明等人提出了残差网络,通过引入跨层连接,降低了训练难度。

残差网络

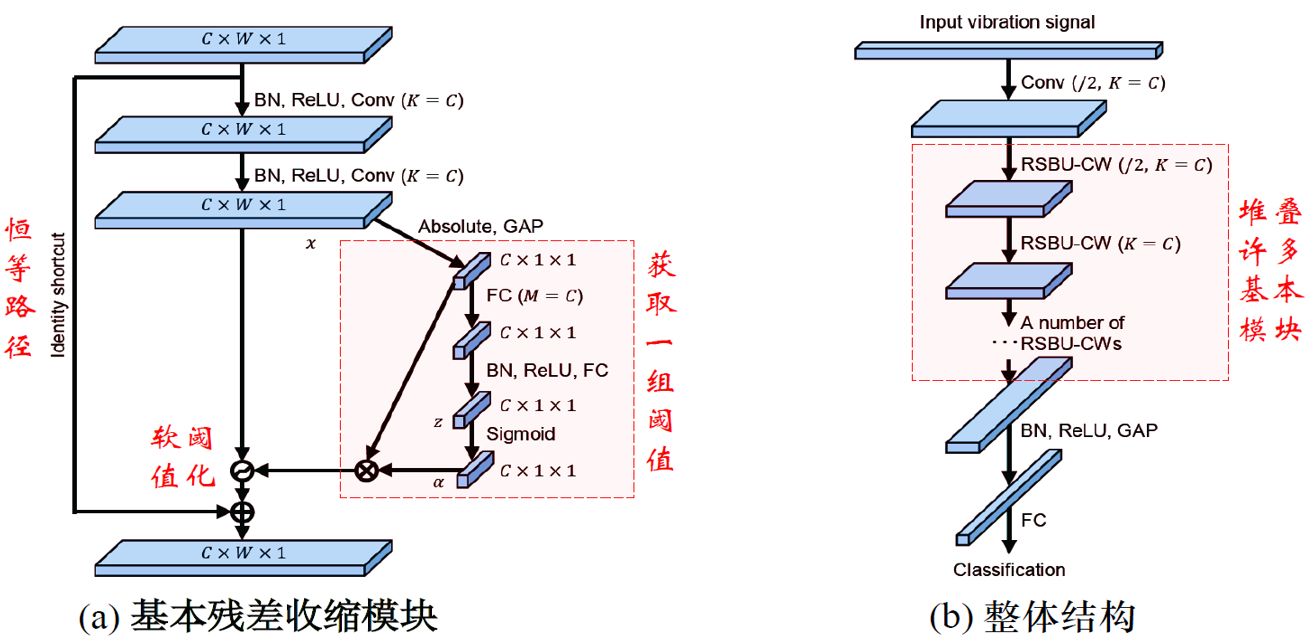

最后,残差收缩网络[1][2]又是残差网络的一种改进,通过采用软阈值化,减轻了噪声的影响。

(面向强噪、高冗余数据的)残差收缩网络

参考

- ^M. Zhao, S. Zhong, X. Fu, B. Tang, M. Pecht, Deep residual shrinkage networks for fault diagnosis, IEEE Transactions on Industrial Informatics, vol. 16, no. 7, pp. 4681-4690, 2020. https://ieeexplore.ieee.org/document/8850096

- ^代码 https://github.com/zhao62/Deep-Residual-Shrinkage-Networks

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)