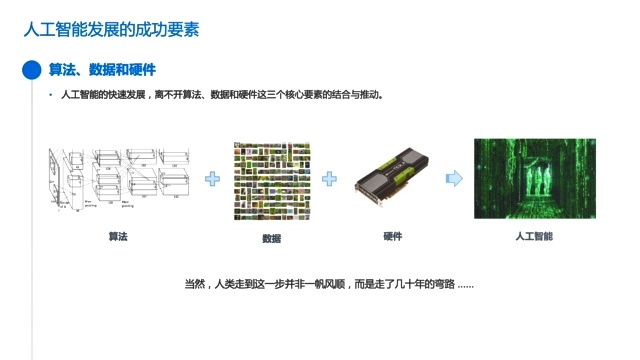

1.4 人工智能发展的成功要素

1.4 人工智能发展的成功要素算法卷积网络→循环网络→生成对抗网络→强化学习AI算法极简史感知器:Rosenblatt 乐观预测感知器 “最终可以学习,做决定,翻译语言”,但《感知器.计算几何简介》一书中指出神经网络需要超大计算量,进入核冬天AI 教父:对脑科学痴迷的 Geoffrey Hinton 一直在研究神经网络,把人工智能作为博士研究方向,与 David Rumelhart 一起解决了线性

·

1.4 人工智能发展的成功要素

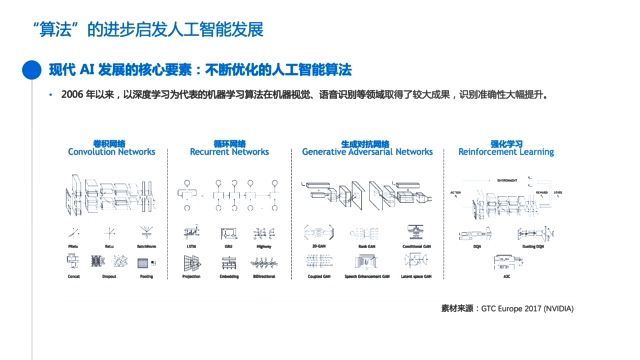

算法

卷积网络→循环网络→生成对抗网络→强化学习

AI算法极简史

- 感知器:Rosenblatt 乐观预测感知器 “最终可以学习,做决定,翻译语言”,但《感知器.计算几何简介》一书中指出神经网络需要超大计算量,进入核冬天

- AI 教父:对脑科学痴迷的 Geoffrey Hinton 一直在研究神经网络,把人工智能作为博士研究方向,与 David Rumelhart 一起解决了线性不可划分的问题,与自己的学生 Yann Lecun 构造出卷积神经网络,用于读取支票上面的手写数字,神经网络领域开始复苏

- 平稳发展期:出现模式识别经典算法:支持向量机,但计算机性能不足、数据量严重缺失、问题复杂度高

- 低谷:AI 教父 Hinton 的实验室成为当时全球唯一支持神经网络研究的机构,并把 “神经网络” 更名为 “深度学习”,06年成为第三次AI浪潮的发源

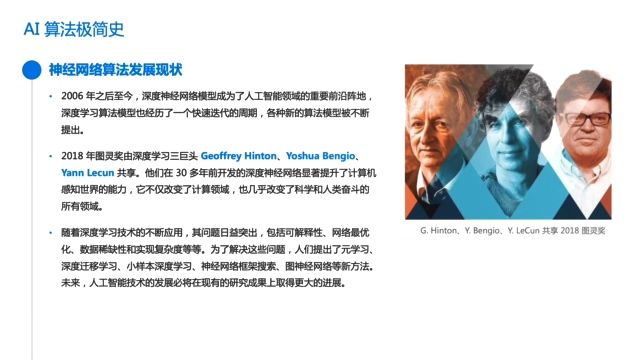

- 现状:2018 年的图灵奖由深度学习三巨头 Geoffrey Hinton、 Yoshua Bengio、 Yann Lecun 共享,直接或间接影响了各个领域的发展

数据

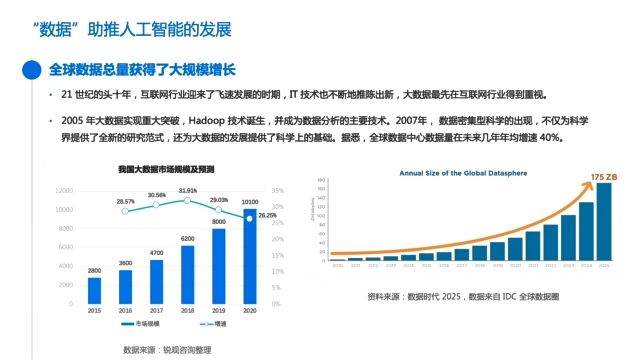

- 全球数据总量获得了大规模增长:全球数据中心数据量在未来几年年均增速40%

- ImageNet 大规模数据集:李飞飞发文建立第一个超大规模图像数据库,把英文里的8万个名词各收集500~1000张高清图片,最后总数据库有五千万以上的图片

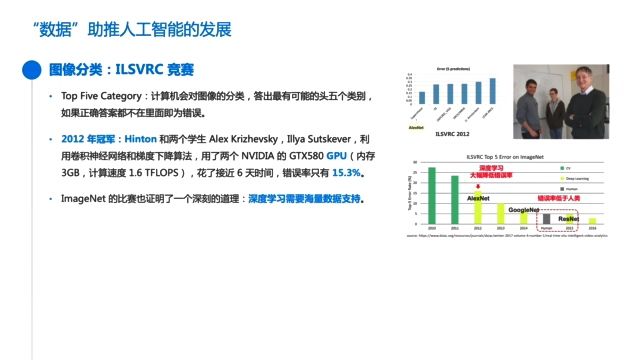

- 图像分类 ILSVRC 竞赛:以 ImageNet 为基础的大型图像识别竞赛,体现出深度学习需要海量的数据支持

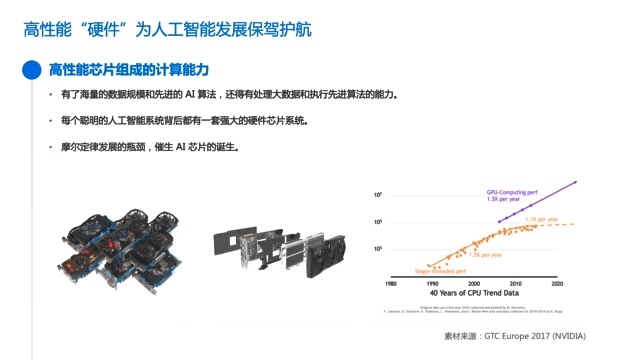

硬件

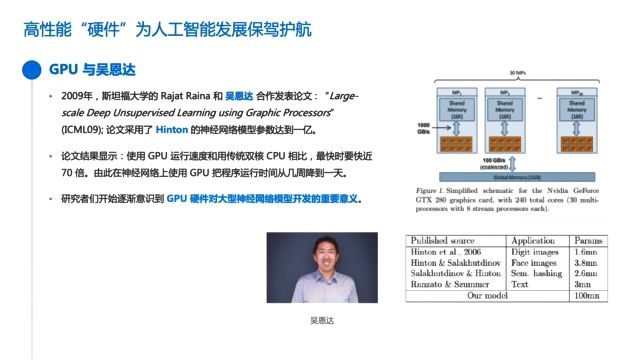

- 2009年吴恩达发现GPU硬件对大型神经网络模型开发有重要作用

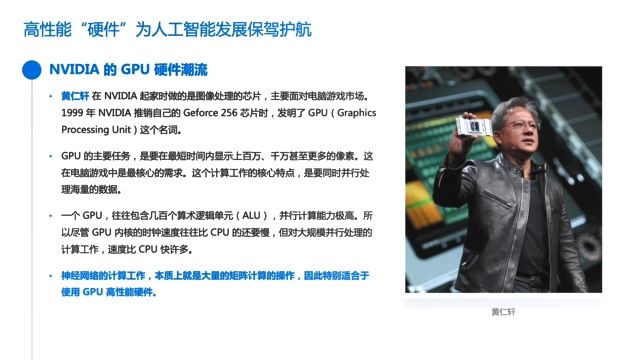

- GPU 这一名词是由黄仁轩创立的 NVIDIA 提出。神经网络的计算工作本质上是大量的矩阵计算操作,因此特别适合于使用 GPU 高性能硬件

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)